Initialement publié dans le blogue de Direction informatique, le 10 mars 2014.

La Commission d’enquête sur l’octroi et la gestion des contrats publics dans l’industrie de la construction a récemment invité les citoyens et les organismes à s’exprimer relativement à l’infiltration de la corruption au sein de processus de gestion publique.

La commission qu’on appelle communément « Commission Charbonneau » devrait favoriser, entre autres, l’implantation d’un système plus intègre et plus équitable. Mais est-ce bien suffisant?

Ce ne sont pas uniquement les processus qu’il faut réviser, c’est aussi l’organisation de l’information : ce qui la rend signifiante et qui facilite le repérage des anomalies et des schémas récurrents.

En janvier dernier, avait lieu à Montréal OpenContracting, une première rencontre sur la standardisation des données relatives aux projets d’aide internationale. La normalisation des métadonnées, ces descripteurs qui décrivent un ensemble de données, permet de connecter entre elles des sources d’information et d’améliorer la traçabilité des flux financiers. La Banque mondiale s’intéresse à cette initiative, car les programmes d’aide au développement sont désormais scrutés par des citoyens et des organismes qui attendent une reddition de compte. Il y a partout, au sein des entreprises comme des gouvernements, un urgent besoin d’organisation et de normalisation des données afin de faciliter le travail des vérificateurs.

Quand on parle de normes et standards dans le domaine des technologies de l’information, on pense surtout à la programmation, aux infrastructures ou aux protocoles, mais rarement aux métadonnées. Et pourtant, comment prendre de bonnes décisions quand les données de nos systèmes ne peuvent se connecter entre elles ?

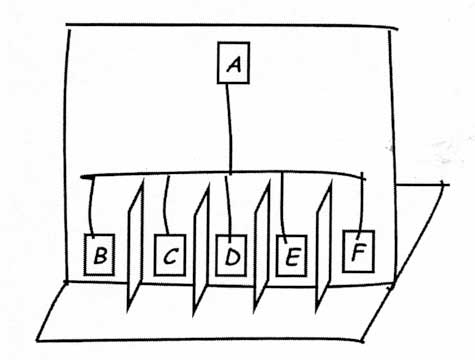

Connecter les ensembles de données

Au sein de processus, comme la gestion de contrats publics, il faudrait une politique de qualité des données et des principes auxquels devraient se conformer les concepteurs de bases de données. Voici quelques exemples :

- La nomenclature de champs commune

- Les formats de métadonnées standards

- Les règles d’intégrité des données (ex.: champ non renseigné et sans explication, valeur incohérente, orthographe inconstante)

Les journalistes qui ont travaillé avec les données comme celles du Système électronique d’appels d’offres (SEAO) du gouvernement du Québec, entre autres, ont pu constater que ces principes ne sont pas appliqués.

Uniformiser les soumissions

Il est beaucoup plus facile d’analyser les renseignements concernant une entreprise, ainsi que les éléments qui sont inclus dans une soumission, lorsque toutes les données requises sont recueillies à l’aide d’un formulaire – d’une façon similaire à une déclaration de revenu. Autrement, les éléments essentiels sont noyés dans un document qui peut dépasser une centaine de pages.

Il faut donc souhaiter l’uniformisation du format des soumissions par l’imposition d’un support numérique, d’une structure et de champs identiques à tous les soumissionnaires d’un même appel d’offres.

La mise à disposition de données fiables, de qualité et à jour est le moyen le plus efficace et le moins coûteux pour contrecarrer la systématisation de pratiques illégales au sein des administrations publiques. Exposer les lacunes du processus et les dérives d’un système est nécessaire, mais il est essentiel, pour une administration publique efficace, vigilante et transparente, d’investir dans la normalisation de ses ensembles de données.

Adopter des principes et des règles communes

Ce qu’il faut retenir des événements de la Journée internationales des données ouvertes, le 22 février dernier, c’est que différentes administrations publiques se préparent à favoriser l’interconnexion des données.

En effet, les villes de Montréal, Québec, Gatineau, Sherbrooke ainsi que le gouvernement du Québec ont convenu de l’adoption d’une licence commune pour la mise à disposition des ensembles de données ouvertes. Il s’agit d’un gros coup de barre vers la normalisation, alors que les silos technologiques, structurels et culturels prévalent au sein des organisations.

Que restera-t-il des révélations de la commission Charbonneau si nous ne nous attaquons pas au cœur du problème qu’est la qualité de l’information?